吴恩达deeplearning.ai课程学习笔记

0. 前言

作业在这里

原仓库被coursera要求删掉了,多亏我及时folk/斜眼笑

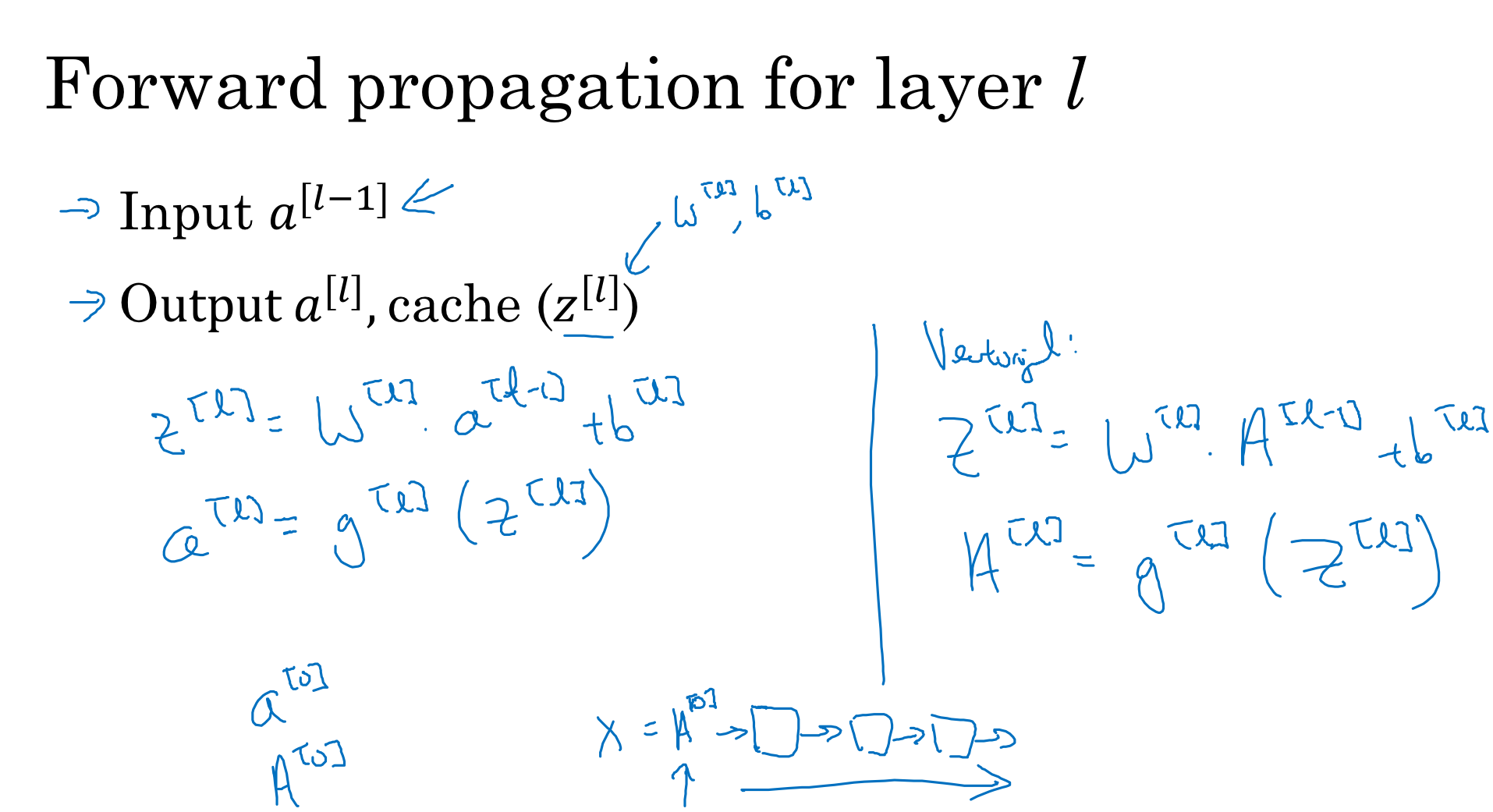

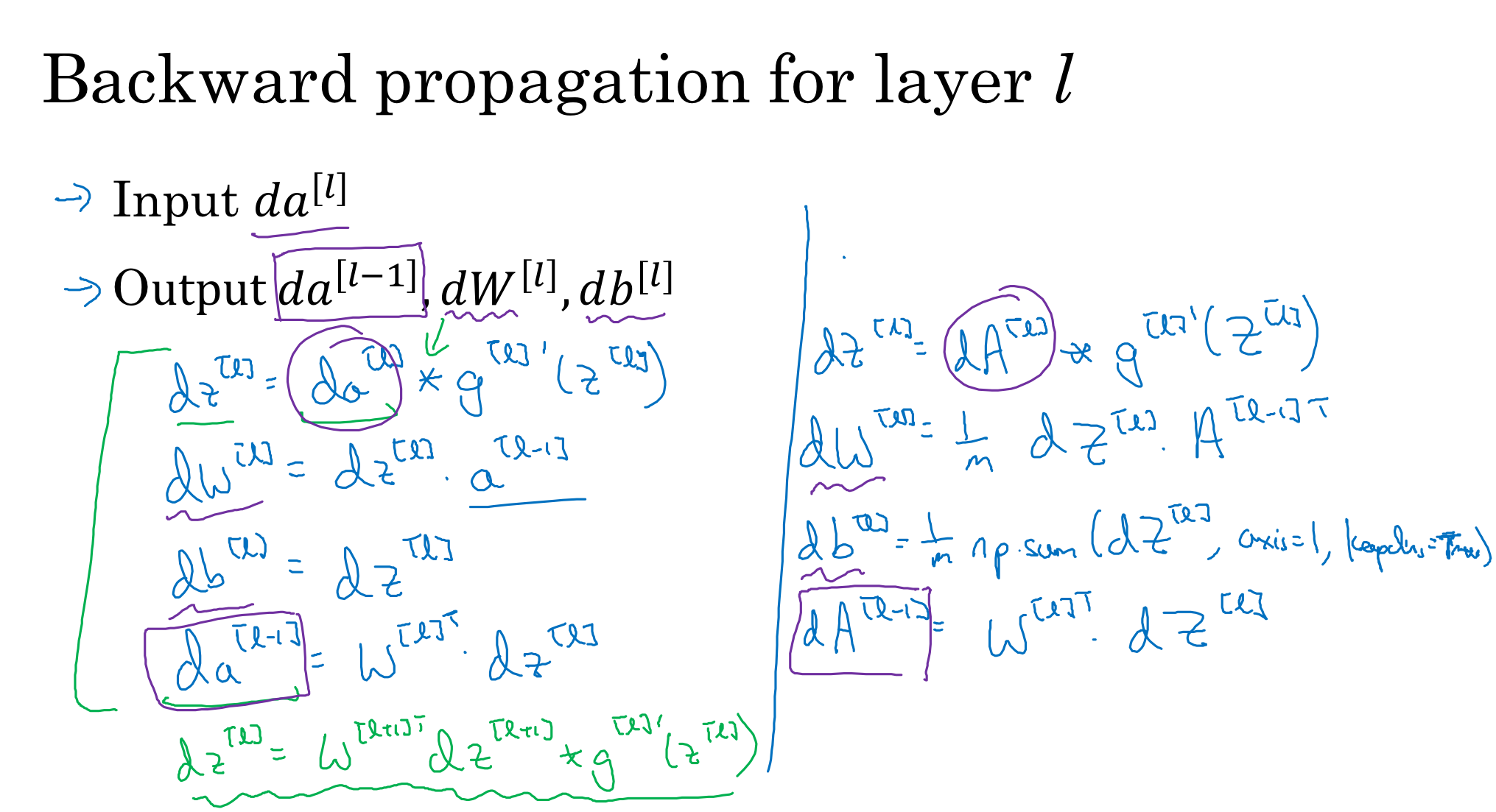

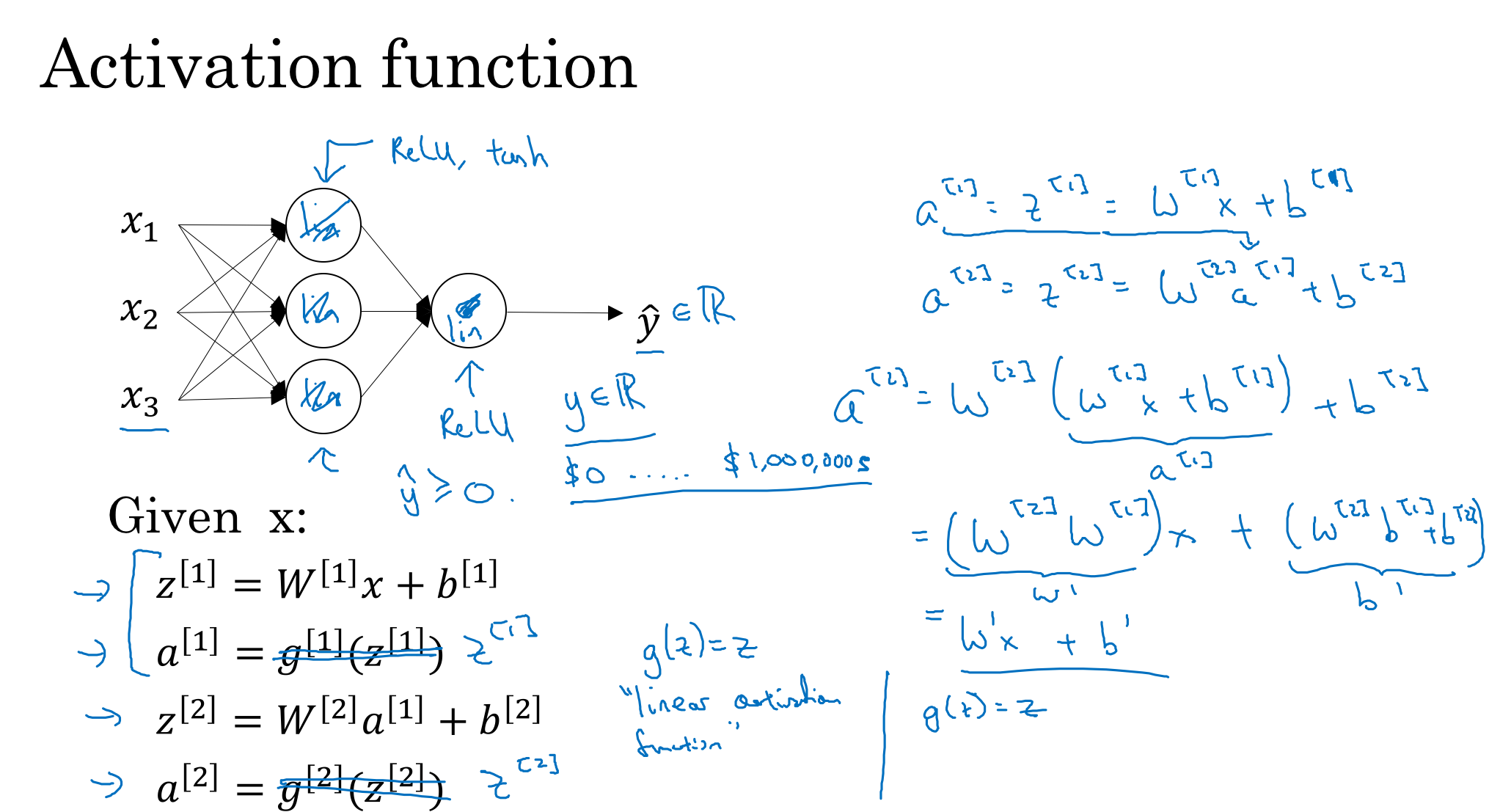

1. 神经网络前馈和后馈

如果没有激活函数的话,多层的神经网络仍然是个线性的模型。

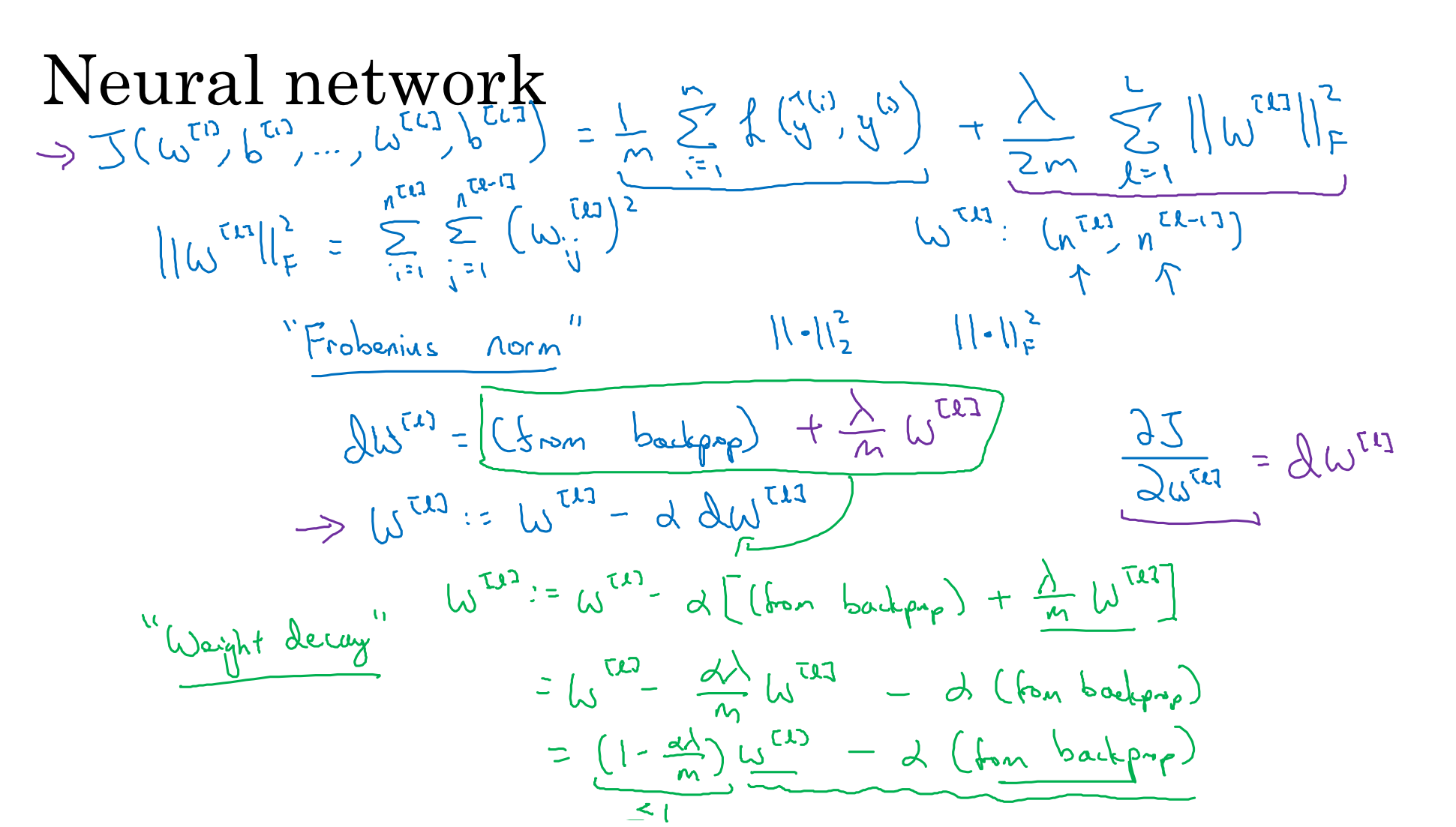

2. 超参数、正则化、优化算法等

L2正则化相当于是w权重减小, weight decay

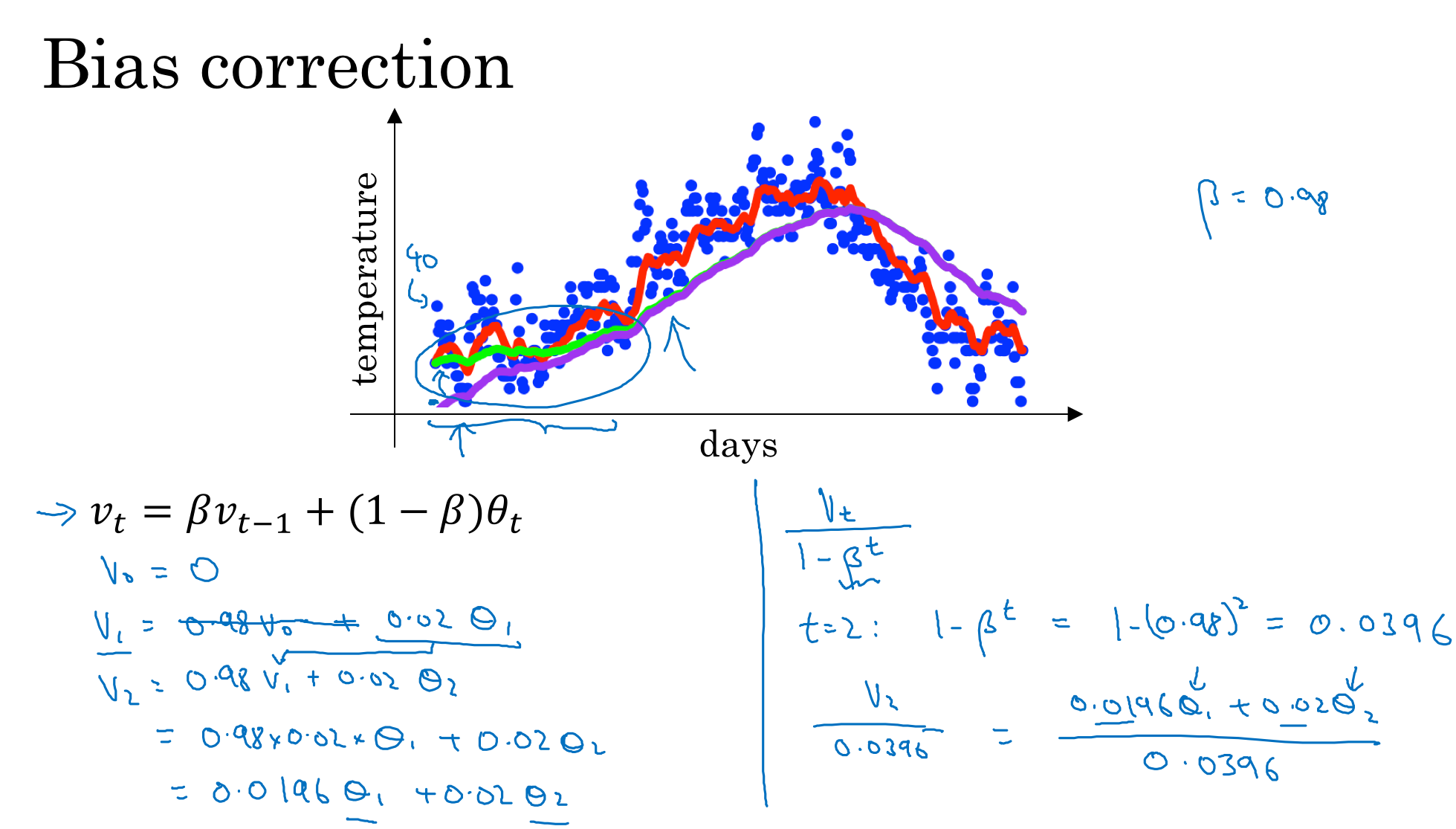

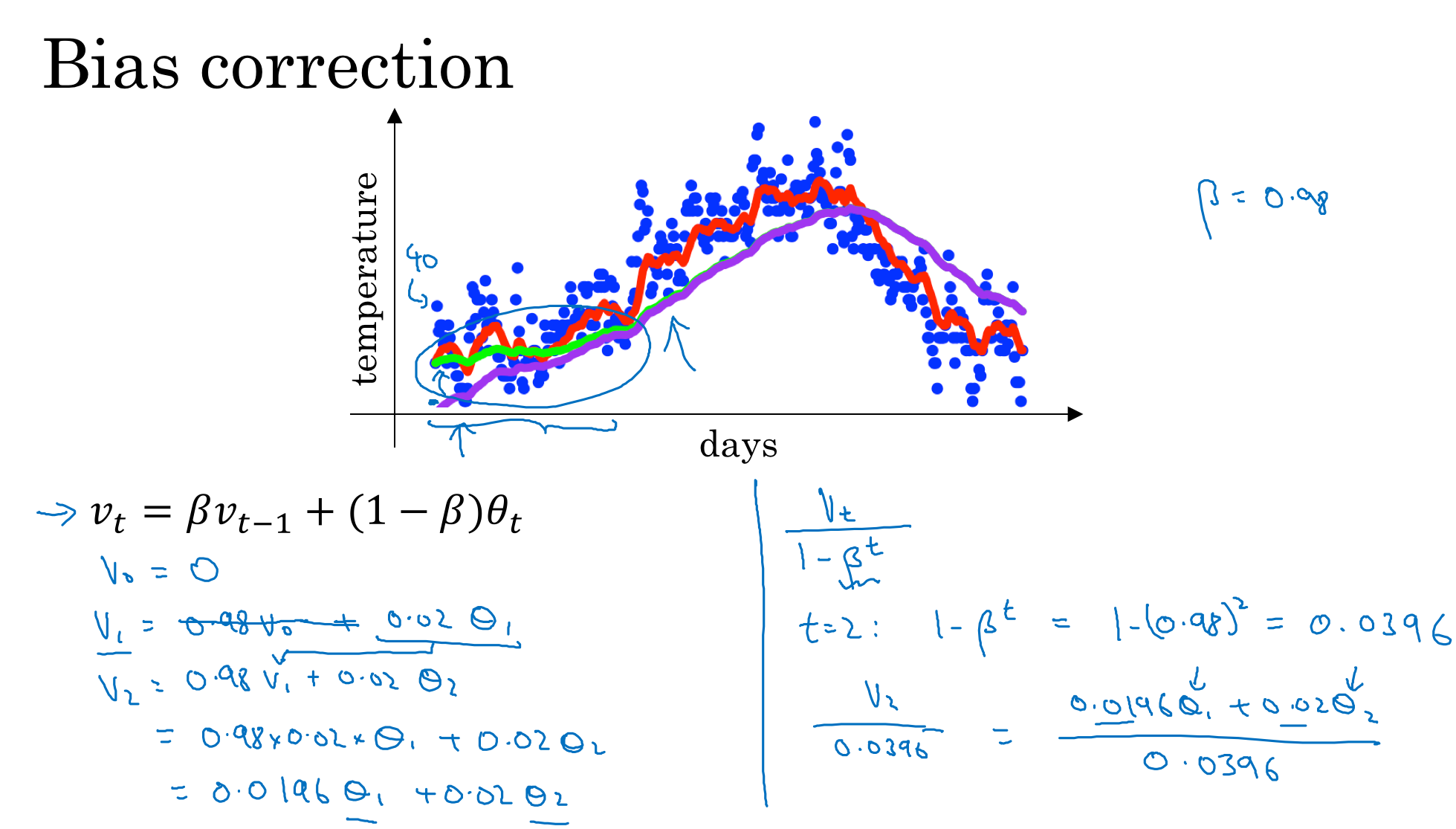

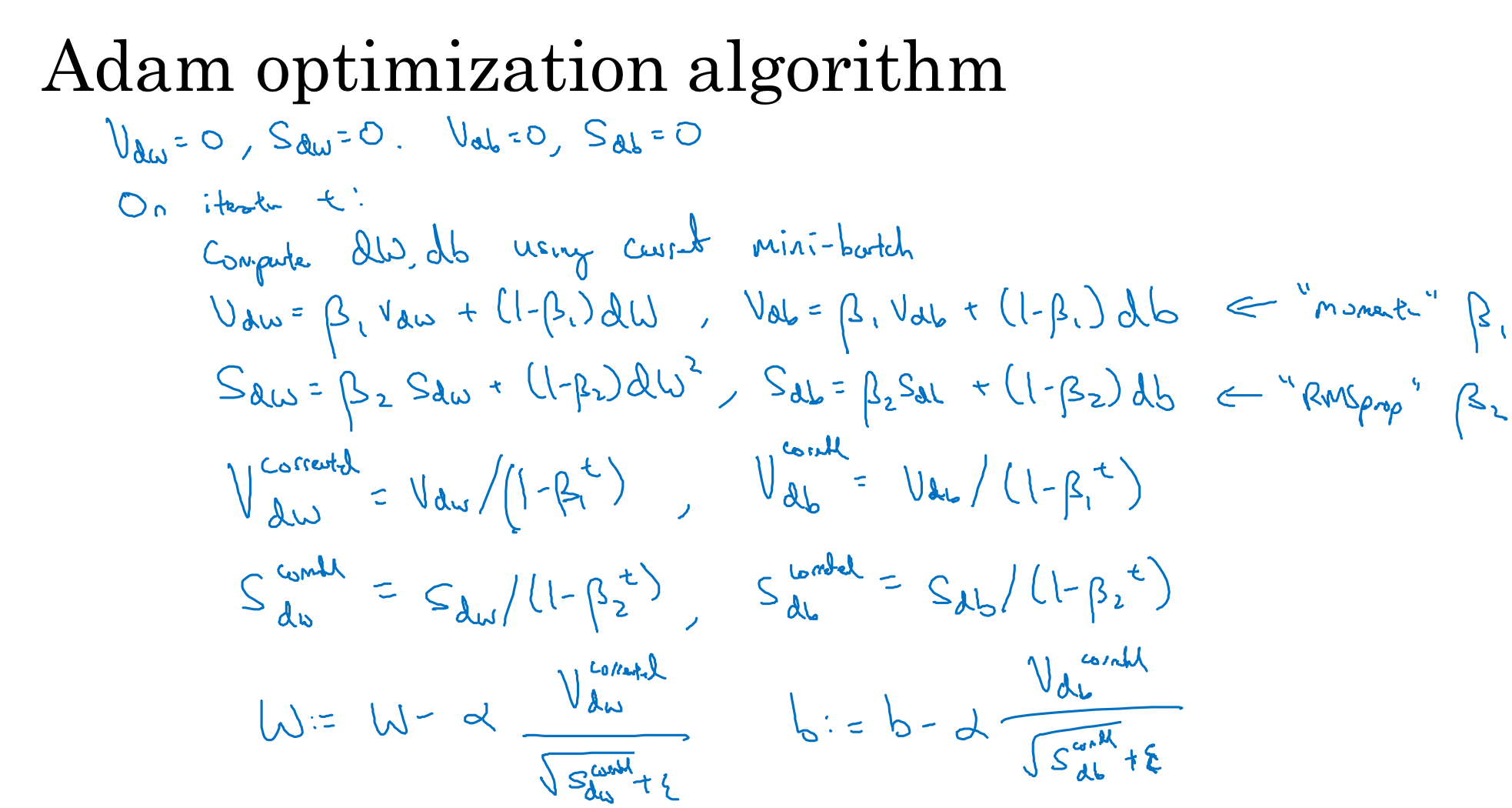

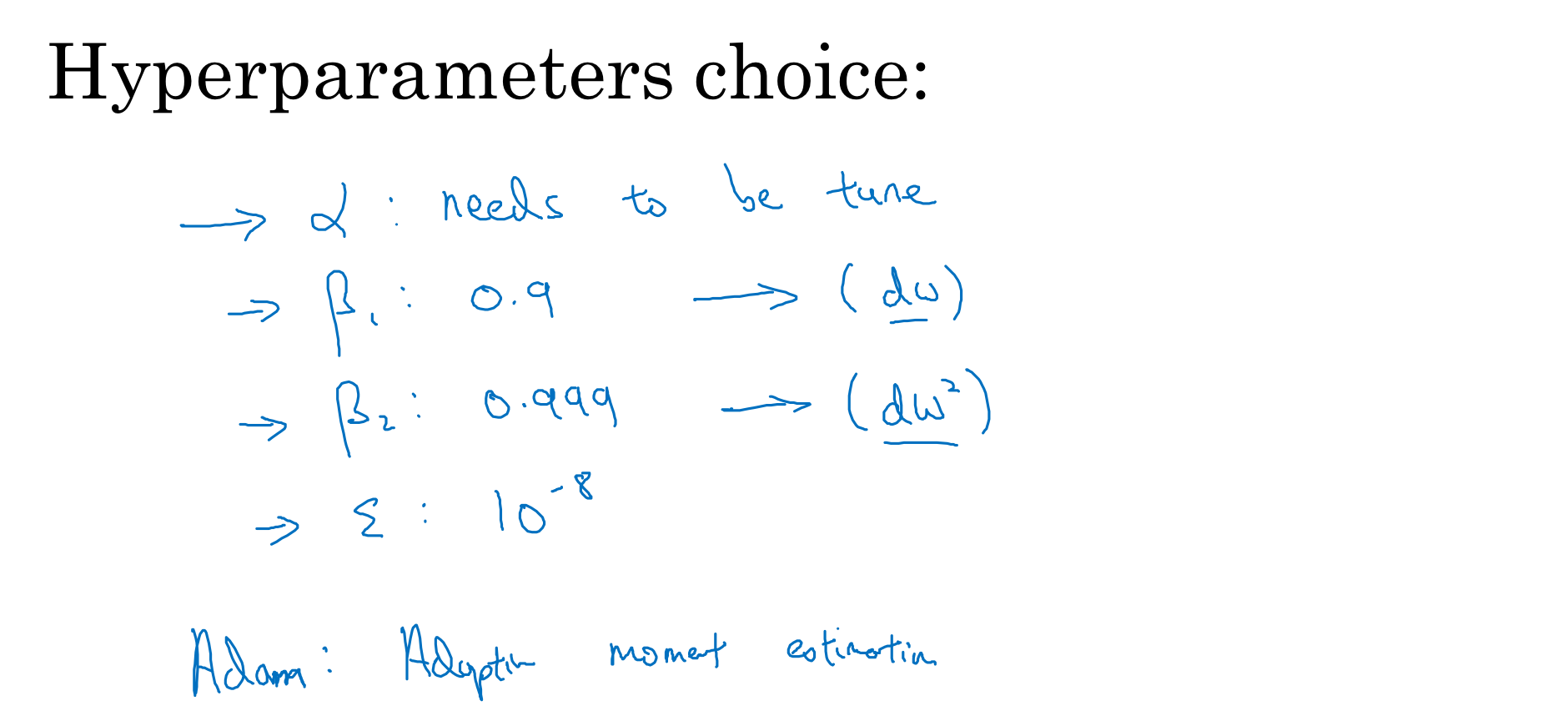

后面等这些是用在mini-batch中的,当训练数据量太大,需要对训练数据分割为mini-batch。但这样会造成收敛方向波动,为了减小这种波动,引入Adam优化算法。

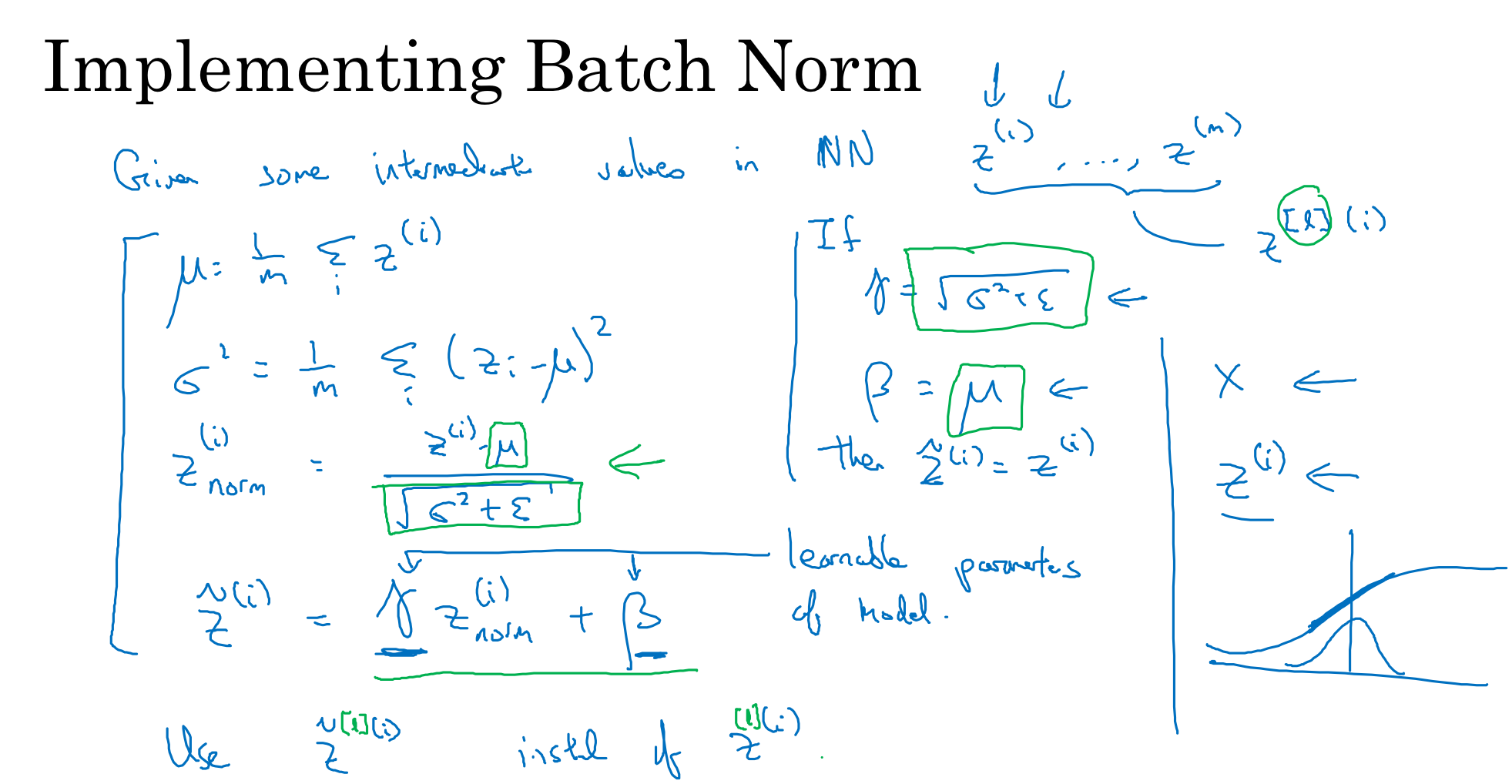

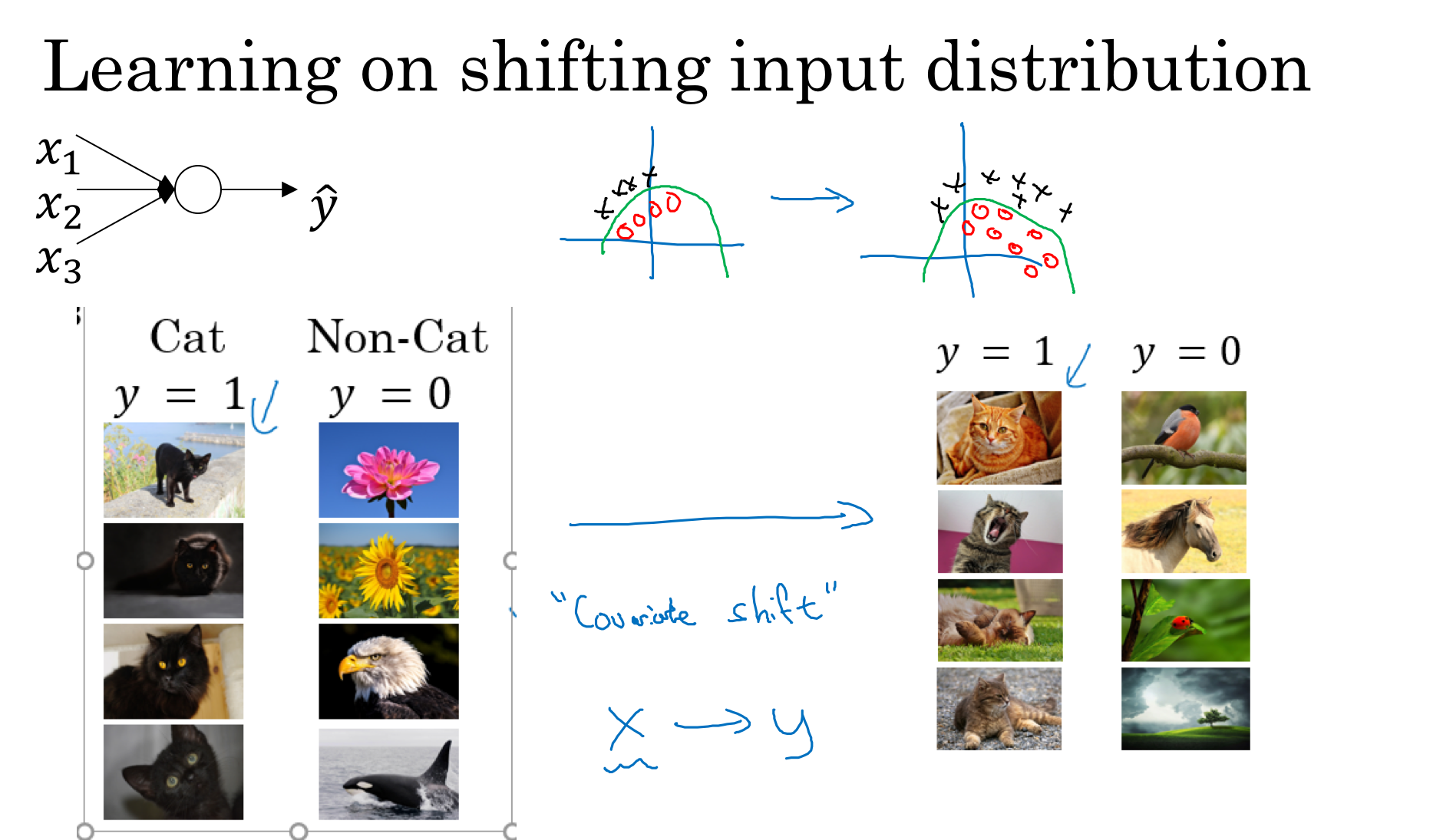

batch norm

3. CNN

待续